Security for AI & AI for Security: Künstliche Intelligenz wird auch zum wichtigen Thema beim IT-Security-Management

Bericht über das Treffen der mbuf Gruppe IT Security Management am 10.07.2025 bei der Microsoft Deutschland GmbH in München.

Inwieweit wirkt sich der Einsatz von AI auf das Security Management in den Unternehmen aus, was sind die Risiken, welche Veränderungen in den Prozessen muss es geben und kann AI auch beim Security Management unterstützen? Das waren die Fragestellungen, die beim Juli-Treffen der mbuf Gruppe IT Security Management bei der Microsoft Deutschland GmbH in München die Agenda bestimmten.

Man traf sich bereits am Vortag, um nach einer Führung durch das beeindruckende EMEA Experience Center im Hause Microsoft gemeinsam im Wirtshaus Brunnwart den Abend zu verbringen. Leider beeinträchtigte ein sehr hoher Geräuschpegel in den Wirtsstuben ein wenig den Austausch untereinander.

Das eigentliche Treffen fand dann im Innovation Hub in der Microsoft Deutschlandzentrale statt. Die Gruppenleiter Norbert Breidohr, Max Gutberlet und Andreas Sternberg konnten deutlich über 30 Teilnehmer begrüßen – eine sehr erfreuliche Resonanz. Nach einem gemeinsamen Frühstück ging Michael Landolt, Microsoft Chief Security Advisor for Supervisory & Executive Board Members, CIOs, CDIOs, CISOs, and CSOs in der EMEA Region, in seiner Keynote auf die Herausforderungen, aber auch auf die Vorteile ein, die der zunehmende Einsatz von Künstlicher Intelligenz mit sich bringt. In diesem Vortrag wurde deutlich, dass der Einsatz von AI auch Risiken in sich trägt. AI-Systeme sind lernende Systeme, die einen breit gefächerten Zugriff auf Unternehmensdaten benötigen, um effizienzsteigernd wirken zu können.

Das bedeutet aber auch gleichzeitig, dass im Unternehmen genau geregelt sein muss, auf welche Daten ein AI-System zugreifen darf. Der Datenklassifizierung – dieser Begriff tauchte dann nachfolgend auch in nahezu allen anderen Beiträgen auf – muss folglich besondere Beachtung geschenkt werden. Eine ausgefeilte Datenklassifizierung ist das unverzichtbare Fundament für jegliche Szenarien der AI-Nutzung! Anders ausgedrückt: Der Einsatz von AI führt zu möglichen neuen Bedrohungspfaden, nicht nur im Hinblick auf einen ungewollten Datenabfluss. Und AI kann auch den Angreifern helfen. Nur wenn mit Hilfe einer eindeutigen Datenklassifizierung Zugriffsrechte geklärt sind, kann man diese Risiken in den Griff bekommen.

Gleichzeitig kann AI natürlich auch genutzt werden, um Angriffe frühzeitig zu erkennen. Microsoft nutzt AI sehr intensiv, um Angriffsversuche und Cyber Security Vorfälle zu erkennen und ggf. davor zu warnen.

Martin Steiner, Solution Engineer Data Security, Compliance & AI Security bei Microsoft und „Pate“ für die mbuf Gruppe IT Security Management, ging nachfolgend zusammen mit Dominik Gursch, Architect Cyber Security beim Microsoft Innovation Hub, noch einmal vertiefend auf die in der Keynote angesprochenen Themen ein und erläuterte am Beispiel zahlreicher Anwendungsfälle, auf was beim Einsatz von KI zu achten ist, welche Risiken man im Blick haben muss, wo aber KI auch beim Security Management unterstützen kann.

In einem letzten Vortrag vor der Mittagspause stellte Dr. Jan Sebastian Zipp die KI-Allianz Baden-Württemberg vor. In der KI-Allianz Baden-Württemberg sollen Wirtschaft, Wissenschaft, Politik und öffentliche Verwaltung gezielt vernetzt werden, um zum Beispiel durch Events rund um das Thema Künstliche Intelligenz und eine intensive Vernetzung das Thema KI als Innovations-Treiber zu beschleunigen. Interessant war der Hinweis, dass für KI-Projekte Fördergelder von Bund und Land abgerufen werden können. Die KI-Allianz unterstützt bei der Antragstellung.

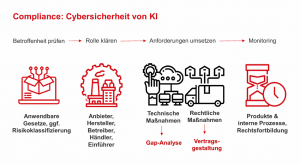

Stefan Hessel, Rechtsanwalt für Datenschutz, Cybersicherheit und IT-Recht, und Christina Kiefer, Rechtsanwältin und Senior Associate, beide von der Reusch Rechtsanwaltsgesellschaft mbH (reuschlaw) gingen in einem hoch interessanten Beitrag auf die rechtlichen Anforderungen an die Cybersicherheit von KI-Systemen ein. Anhand von konkreten Fallbeispielen wurde deutlich gemacht, welche Regelungen zu beachten sind. Wichtige Erkenntnisse für alle Teilnehmer aus der Präsentation und der Diskussion unter den Anwesenden:

- Der EU AI Act verpflichtet quasi alle Unternehmen zu teils umfangreichen Maßnahmen.

- Insbesondere der Artikel 4 des EU AI Act ist zu beachten:

Zwingende Schulung für alle Mitarbeiter in Sachen KI Nutzung! - Bei Hoch-Risiko-Systemen sind besondere Datenschutz- und Sicherheitsmaßnahmen vorzusehen (Art. 15 EU AI Act).

- Man kommt um die Bewertung aller Risiken nicht herum. Das Ergebnis der Risikobewertung muss dokumentiert werden.

- Transparenz und Dokumentation kommen eine große Bedeutung zu.

- Nicht nur der EU AI Act spielt eine Rolle, sondern es sind auch rechtliche Anforderungen aus den Regelungen nach dem EU Cyber Resilience Act (CRA) oder nach NIS-2 zu beachten.

- Ein Unternehmen kann auch unternehmensintern oder unternehmensgruppenintern zum Serviceanbieter werden und dadurch speziellen Regelungen unterliegen.

- Es können auch Anforderungen aus der Nutzung von externen 3rd Party Lösungen entstehen, wenn diese KI-Technologien nutzen.

Eine gut aufbereitete Übersicht zu den Anforderungen nach EU AI Act findet man zum Beispiel auch hier.

Mit einer Präsentation von Roman Innerbichler, Senior Sales Engineer beim Schweizer Security-Anbieter Ontinue, endete der Reigen der Vorträge. Er zeigte, wie mit Hilfe von „Agentic AI“ die Automation im SOC perfektioniert werden kann.

Wollte man diesen Tag in einem einzigen Satz zusammenfassen, dann müsste der ungefähr so lauten: Die Teilnehmer dieses Gruppentreffens konnten in einer teils beeindruckenden Umgebung nicht nur von einer hervorragenden Bewirtung profitieren und den persönlichen Austausch gewinnbringend pflegen, sondern auch aus den Vorträgen und den Diskussionen hierzu zahlreiche Informationen und Impulse für die Arbeit in ihren Unternehmen mitnehmen.

Das nächste Treffen der Gruppe (neben dem ständigen Austausch auf der mbuf internen Teams Plattform) findet am 12./13. November 2025 bei HORNBACH in Bornheim bei Landau in der Pfalz statt. Wer Interesse hat, sich in der mbuf Gruppe IT Security Management einzubringen, nimmt Kontakt mit der mbuf Geschäftsstelle auf (info@mbuf.de).